KOMPETENCJE

Wizerunek firmy decyduje dziś o przewadze konkurencyjnej na rynkach wielu branż. Przestaje się liczyć, ile konkurencyjnych firm istnieje na rynku. Ważne, ile z nich dostrzegają klienci. Dlatego zajmujemy się kreowaniem wizerunku marek, produktów i usług. Dzięki niemu możesz zyskać długotrwałą przewagę konkurencyjną.

STRATEGIA

planowanie, dobór narzędzi, egzekucja, badania,

audyt

audyt

BRANDING

identyfikacja, wizerunek, komunikacja 360

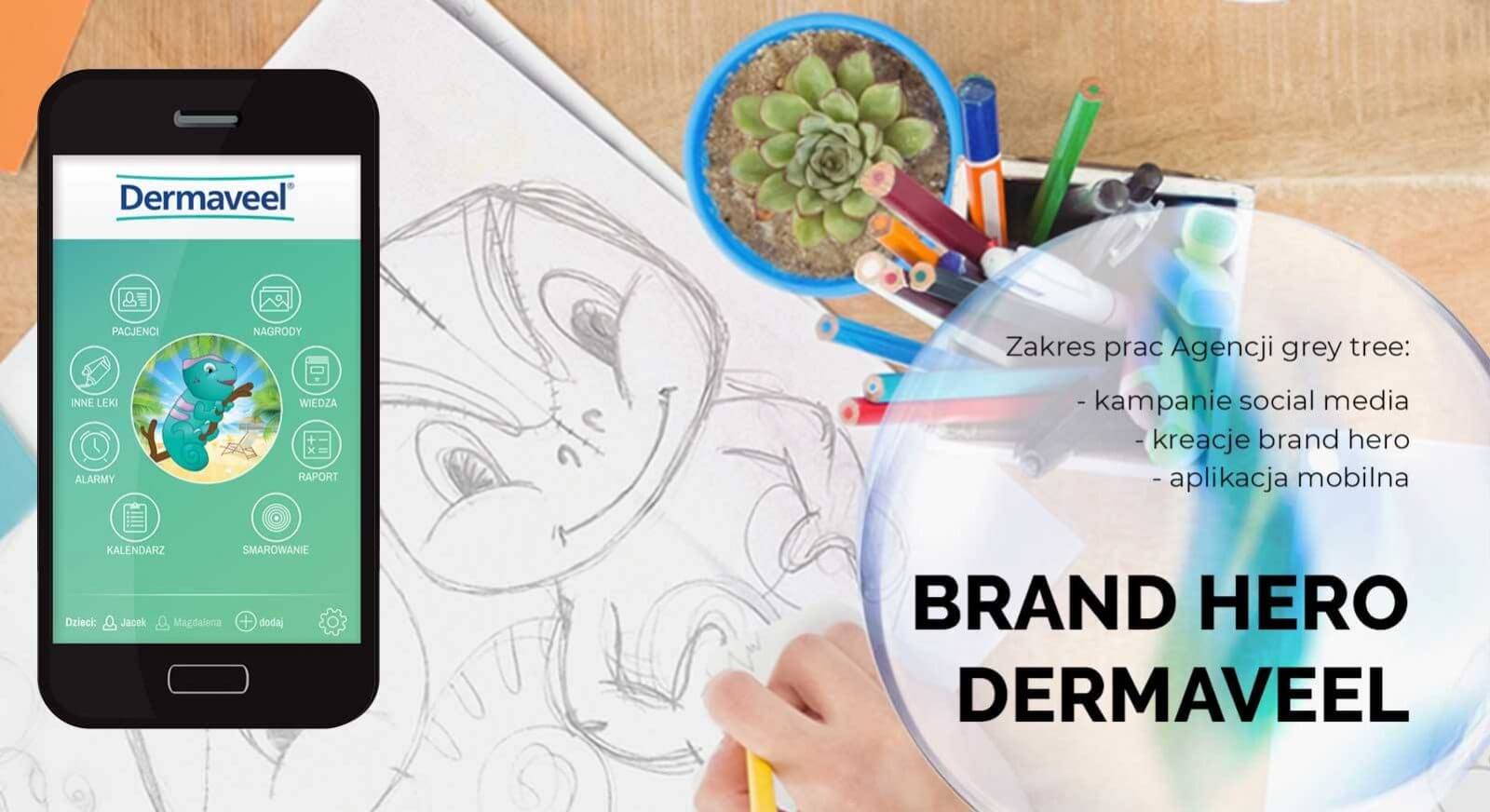

PHARMA MARKETING

kreacja, reklama Rx, OTC, suplementy diety, POS, mobile, digital

SOCIAL MEDIA

profile, zaangażowanie, kampanie reklamowe, monitoring

FOTOGRAFIA

reklamowe, reportaże, sesje produktowe, content creating

ZAUFALI NAM

NASZE STANDARDY

Agencja grey tree to grupa ludzi, której powierza się ważne, strategiczne zadania, dlatego wybieraj sprawdzonych ludzi.

- Działamy zespołowo!

- Wspólnie realizujemy misję agencji i godnie reprezentujemy firmę na zewnątrz.

- Przestrzegamy standardów Agencji grey tree.

- Jesteśmy uczciwi wobec klientów i wobec siebie.

- Zachowujemy poufność.

- Bierzemy odpowiedzialność zarówno za czyny, jak i słowa.

- Samodoskonalenie jest naszym obowiązkiem.

- Standardem współpracy jest dobra, dwustronna komunikacja…